github:

https://github.com/lihaoyun6/ComfyUI-llama-cpp_vlm

该节点是为 ComfyUI(一个基于节点式工作流的 AI 创作工具)开发的扩展,核心是集成

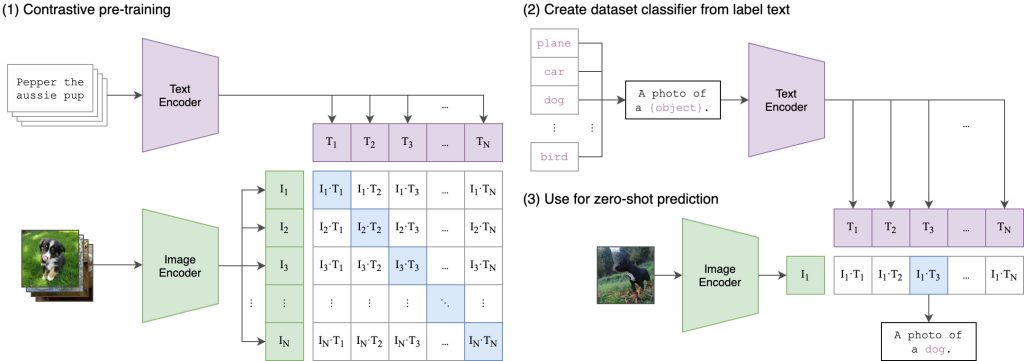

llama.cpp 框架对多模态大语言模型(VLM,Vision-Language Model) 的支持,简单来说:1. 核心定位

将 llama.cpp 对视觉 – 语言多模态模型的推理能力,封装为 ComfyUI 的可视化节点,让用户无需编写代码,仅通过拖拽节点即可调用 VLM 模型完成「图像 + 文本」的交互任务。

2. 关键功能

- 多模态模型推理:支持基于 llama.cpp 兼容的 VLM 模型(如 LLaVA、Mini-LLaVA、BakLLaVA 等视觉 – 语言模型),实现「图像理解 + 文本问答 / 生成」。

例:输入一张图片 + 提问 “这张图里有什么?”,节点返回自然语言回答;或输入图片 + 指令 “描述这张图的细节”,生成对应文本。

- llama.cpp 特性集成:继承 llama.cpp 轻量级、跨平台、低资源占用的优势,支持 CPU/GPU 混合推理,即使低配设备也能运行 VLM 模型。

- ComfyUI 工作流适配:节点可与 ComfyUI 现有节点(如图像加载、文本处理、输出渲染)无缝衔接,比如:

- 从 ComfyUI 加载生成的图片 → 送入该 VLM 节点 → 生成图片描述 → 再将描述送入文本生成节点继续创作。

3. 典型使用场景

- 图像内容理解与问答(视觉问答,VQA);

- 图片的自然语言描述生成;

- 结合 ComfyUI 的图像生成 / 处理流程,实现 “看图说话”“以图生文” 等多模态创作;

- 本地化部署 VLM 模型(无需联网),兼顾隐私与低延迟。

4. 核心依赖与原理

- 底层依赖

llama.cpp:一个高性能、轻量级的 LLM/VLM 推理框架,支持 GGUF 格式的模型文件(目前主流的量化模型格式); - 节点封装了 llama.cpp 的 VLM 推理接口,对外暴露「模型路径、图像输入、文本提示、推理参数(温度、top_k 等)」等可视化参数,让用户可灵活调整。

总结

这个节点的核心价值是:降低 ComfyUI 中调用本地化 VLM 模型的门槛,让非技术用户也能通过节点工作流,快速实现 “图像 + 文本” 的多模态交互,拓展 ComfyUI 从纯图像 / 文本创作到多模态创作的能力。

whl安装:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END