github:

https://github.com/huchukato/ComfyUI-QwenVL-Mod

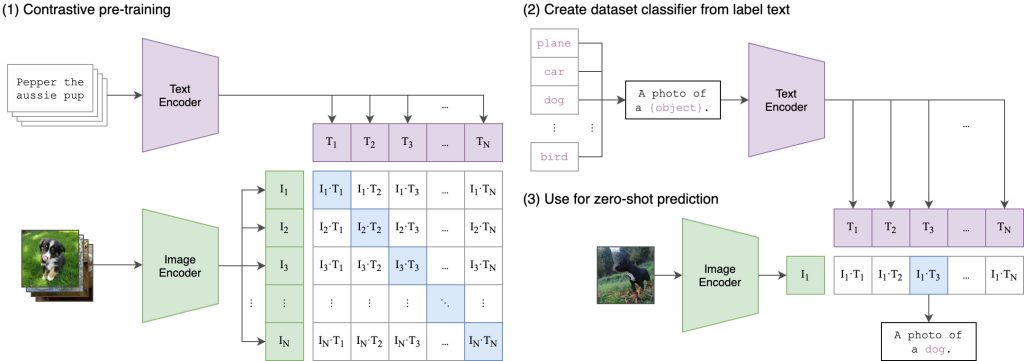

该仓库是基于 阿里云通义千问视觉语言模型(Qwen-VL) 为 ComfyUI 开发的扩展模块(Mod),核心是将 Qwen-VL 的多模态能力集成到 ComfyUI 可视化工作流中,让用户可以在 ComfyUI 里调用 Qwen-VL 完成图文交互类任务。

1. 核心定位

ComfyUI 是一个基于节点式可视化编程的 AI 工作流工具(常用于 Stable Diffusion 等生成式 AI 流程编排),而该扩展的核心作用是:

- 为 ComfyUI 新增 Qwen-VL 相关节点,实现「图片理解 + 文本交互」的多模态能力;

- 让用户无需脱离 ComfyUI 环境,即可调用 Qwen-VL 完成图文问答、视觉分析、内容生成等任务。

2. 主要功能场景

基于 Qwen-VL 的能力,该扩展可实现:

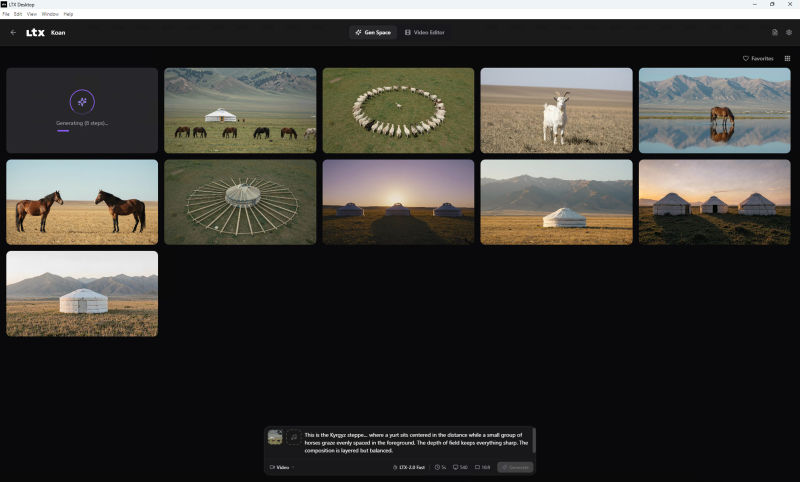

- 图文问答:上传图片后,通过文本提问获取图片内容解析(如 “这张图片里有什么?”“图中的人物在做什么?”);

- 视觉分析:提取图片中的关键信息(物体、场景、文字、颜色、空间关系等);

- 多模态生成:结合图片信息生成描述文本、创意文案、结构化信息(如表格、总结);

- 跨模态指令执行:基于图片内容执行复杂指令(如 “根据这张风景图写一段诗歌”“把图中的手写文字转为电子版”)。

3. 技术层面特点

- 适配 Qwen-VL 的 API / 本地部署版本(需结合 Qwen-VL 的调用方式,如 API Key 或本地模型权重);

- 以 ComfyUI 节点化的方式封装 Qwen-VL 的调用逻辑,用户可拖拽节点、配置参数(如提问文本、图片路径、模型版本),无需手写代码;

- 可与 ComfyUI 其他节点(如图片加载、文本生成、图片处理)联动,构建更复杂的多模态工作流(例如:SD 生成图片 → Qwen-VL 解析图片 → 根据解析结果再生成新内容)。

4. 适用人群

- ComfyUI 使用者,需要在工作流中集成图文理解能力;

- 开发者 / 设计师,快速搭建多模态 AI 应用原型;

- 对 Qwen-VL 感兴趣,希望通过可视化方式调试、调用该模型的用户。

补充说明

使用该扩展通常需要:

- 部署 ComfyUI 环境;

- 准备 Qwen-VL 的调用权限(API Key)或本地部署 Qwen-VL 模型;

- 按照仓库文档将扩展安装到 ComfyUI 的

custom_nodes目录下。

如果需要具体的使用 / 部署细节,可参考该仓库的 README 文档(通常包含安装步骤、节点说明、示例工作流)。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END